1. Giới thiệu

Bài viết “Medical AI and Clinician Surveillance — The Risk of Becoming Quantified Workers” được công bố trên The New England Journal of Medicine ngày 19/6/2025, bởi nhóm tác giả I. Glenn Cohen (Harvard Law School), Ifeoma Ajunwa (Emory Law School) và Ravi B. Parikh (Emory University School of Medicine).

Bài viết đưa ra cảnh báo rằng, khi trí tuệ nhân tạo (AI) ngày càng được tích hợp sâu trong y học, các công cụ được thiết kế nhằm hỗ trợ bác sĩ có thể vô tình biến họ thành “những người lao động bị định lượng” (quantified workers) — tức là đối tượng bị giám sát, đo lường và kiểm soát hành vi làm việc thông qua dữ liệu và thuật toán. Dưới góc nhìn đạo đức – pháp lý, đây là vấn đề đang nổi lên trong kỷ nguyên y học số, khi quyền tự chủ nghề nghiệp và tự do chuyên môn của bác sĩ có thể bị xói mòn dần.

Các tác giả cho rằng, y học cần sớm học bài học từ các ngành nghề khác, nơi việc ứng dụng AI đã dẫn đến giảm quyền tự chủ, tăng giám sát, và điều kiện làm việc tồi tệ hơn. Nếu không hành động ngay, bác sĩ có thể trở thành đối tượng bị “định lượng hóa” trong chính hệ thống y tế mà họ phục vụ.

BIODAS Team hân hạnh giới thiệu tổng quan này nhằm mang lại góc nhìn toàn diện về trí tuệ nhân tạo (AI) trong giám sát và đánh giá nhân viên y tế — một chủ đề đang định hình lại mối quan hệ giữa công nghệ, đạo đức và quyền nghề nghiệp của bác sĩ trong kỷ nguyên y học số. Bài viết tóm lược những cảnh báo và đề xuất chính từ New England Journal of Medicine (2025), giúp độc giả hiểu rõ hơn các rủi ro và hướng ứng phó khi AI ngày càng tham gia sâu vào thực hành lâm sàng.

2. Bối cảnh chung

Trong nhiều lĩnh vực lao động hiện nay, đặc biệt là logistics, tài chính, hay công nghệ, người lao động đã phải làm việc dưới sự giám sát của các “quản lý cơ học” (mechanical managers) — các hệ thống AI theo dõi thao tác, hành vi, vị trí, và hiệu suất công việc theo thời gian thực (1). Mặc dù y học được cho là lĩnh vực mang tính nhân văn cao, nhưng sự phát triển nhanh chóng của AI đang khiến các hoạt động chuyên môn lâm sàng dần rơi vào quỹ đạo tương tự.

Các hệ thống AI y tế ban đầu được phát triển với mục tiêu tích cực như giảm gánh nặng hành chính, tăng độ chính xác và chuẩn hóa quy trình chăm sóc. Tuy nhiên, khi khả năng phân tích dữ liệu và ngôn ngữ tự nhiên (NLP) của AI ngày càng mạnh mẽ, những công cụ này có thể được tái sử dụng để đánh giá hiệu suất và kiểm soát hành vi bác sĩ — đôi khi vượt khỏi mục đích ban đầu của chúng.

3. Ba hình thức giám sát phổ biến của AI trong y học

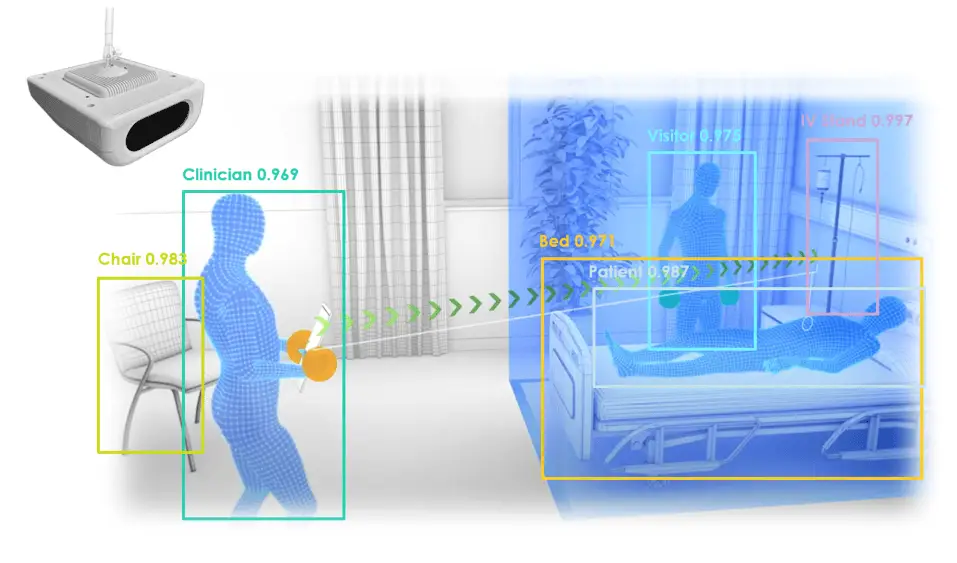

3.1. Ambient AI Scribe: Ghi âm, phiên âm và phân tích hội thoại

Ambient AI Scribe là các hệ thống ghi âm, phiên âm và phân tích cuộc hội thoại giữa bác sĩ và bệnh nhân, được thiết kế để tự động tạo ghi chú lâm sàng nhằm giảm gánh nặng tài liệu (2). Tuy nhiên, chúng có khả năng phân tích giọng điệu, cảm xúc và ngôn ngữ, cho phép bệnh viện đánh giá tần suất bác sĩ lệch khỏi hướng dẫn chuyên môn hoặc phát hiện “outliers” — những người dành quá nhiều thời gian với bệnh nhân so với chuẩn “hiệu quả” (3).

Việc AI tạo ra “điểm hiệu suất” dựa trên thời gian khám, mức độ tuân thủ giao thức, hoặc mô hình giao tiếp có thể khiến các bác sĩ bị xếp hạng hoặc giám sát khắt khe hơn bao giờ hết.

3.2. Phân tích tin nhắn bệnh nhân trong EHR: Đo lường mức độ đồng cảm

Các công cụ AI có thể đọc, tóm tắt và phản hồi tin nhắn bệnh nhân trong hệ thống bệnh án điện tử (EHR) để giúp bác sĩ phân loại và trả lời nhanh hơn. Tuy nhiên, chúng cũng có thể theo dõi thời gian phản hồi, giọng điệu, cấu trúc và “mức độ đồng cảm” trong từng tin nhắn. Một nghiên cứu cho thấy phản hồi do AI tạo ra được đánh giá là “đồng cảm hơn” bác sĩ thật (4).

Khi thù lao và đánh giá năng lực của bác sĩ ngày càng gắn liền với mức độ hài lòng của bệnh nhân, việc đưa thêm yếu tố “đánh giá cảm xúc” bằng AI có thể làm sai lệch cách thức giao tiếp và ra quyết định y khoa — khiến AI trở thành “giám khảo” vô hình trong mối quan hệ bác sĩ – bệnh nhân.

3.3. Ghi vết thời gian và hồ sơ pháp lý

Một tiền lệ đáng chú ý (5): trong một ca phẫu thuật cột sống có biến chứng, hệ thống EHR tự động ghi nhận các khoảng thời gian dài không có dữ liệu nhập vào, mâu thuẫn với lời khai của bác sĩ gây mê rằng ông đã theo dõi liên tục bệnh nhân. Khi AI ngày càng thu thập dữ liệu chi tiết hơn, nó có thể đồng thời giúp phát hiện sai sót an toàn và cũng có thể gây ra hậu quả pháp lý nghiêm trọng đối với nhân viên y tế.

4. Ai dễ bị tổn thương nhất?

Theo nhóm tác giả, tất cả các nhân viên y tế đều có thể chịu ảnh hưởng từ giám sát AI, nhưng nhóm dễ bị tổn thương nhất là những người ít quyền lực trong tổ chức — như bác sĩ nội trú, bác sĩ hợp đồng ngắn hạn, hoặc những người mới vào nghề. Họ thường không có tiếng nói trong việc thiết kế và triển khai hệ thống AI, và có nguy cơ bị đánh giá hoặc kỷ luật dựa trên dữ liệu mà họ không thể kiểm chứng hoặc phản biện.

5. Chiến lược ứng phó cho nhân viên y tế

5.1. Phản ứng công nghệ và giới hạn đạo đức

Trong các ngành khác, người lao động đôi khi “vô hiệu hóa” hệ thống giám sát bằng công cụ như “mouse jigglers” để giả lập hoạt động liên tục (1). Tuy nhiên, trong môi trường y khoa, việc can thiệp vào hệ thống AI có thể ảnh hưởng trực tiếp đến an toàn bệnh nhân và tính hợp pháp của hồ sơ.

5.2. Sức mạnh của công khai và phản biện xã hội

Năm 2018, Amazon từng đăng ký bằng sáng chế vòng đeo tay phản hồi xúc giác để giám sát công nhân kho hàng. Sau khi bị công khai và vấp phải phản ứng dữ dội từ dư luận, kế hoạch này đã bị hủy bỏ (1). Tương tự, các bác sĩ có thể sử dụng truyền thông và công chúng như một “lá chắn đạo đức”, yêu cầu minh bạch và giám sát độc lập đối với các công cụ AI trong bệnh viện.

5.3. Cơ chế pháp lý và quyền nghề nghiệp

Nhóm tác giả nhấn mạnh vai trò của công đoàn trong việc phản đối các hình thức giám sát xâm phạm. Ví dụ, công đoàn y tá tại Kaiser Permanente đã phản đối việc triển khai chatbot và công cụ AI khác. Ngoài ra, Luật An toàn và Sức khỏe Nghề nghiệp (OSHA) có thể cho phép bác sĩ từ chối công nghệ gây nguy hiểm cho môi trường làm việc. Các nhà lập pháp Hoa Kỳ cũng đang thảo luận về “AI Worker Bill of Rights” — quy định rõ quyền của người lao động trong thời đại AI (1).

6. Hiến chương Quyền của Bác sĩ với AI

Nhằm bảo vệ quyền lợi của đội ngũ y tế, nhóm tác giả đề xuất một “Clinician Bill of Rights for AI” (Hiến chương Quyền của Bác sĩ với AI) gồm bốn trụ cột chính:

| Quyền | Nội dung |

|---|---|

| Quyền Thông tin | Bác sĩ phải được thông báo khi AI được sử dụng trong chăm sóc bệnh nhân. |

| Quyền Tham gia | Hệ thống y tế cần có cơ chế quản trị minh bạch và cho phép bác sĩ tham gia ra quyết định. |

| Quyền Riêng tư | Bác sĩ cần biết dữ liệu AI về hoạt động của họ được chia sẻ với ai và vì lý do gì. |

| Đảm bảo Chất lượng | Các công cụ AI có rủi ro cao phải được đánh giá định kỳ, kết quả được công bố minh bạch cho bác sĩ (1). |

7. Kết luận

AI mở ra tiềm năng to lớn trong y học — từ hỗ trợ chẩn đoán, giảm sai sót đến nâng cao hiệu quả vận hành. Tuy nhiên, nếu không có khung pháp lý và đạo đức rõ ràng, các công cụ này có thể biến nhân viên y tế thành “đối tượng dữ liệu”, bị đánh giá và điều khiển bởi hệ thống. Việc thiết lập ranh giới giữa hỗ trợ và kiểm soát là yếu tố then chốt để bảo vệ quyền tự chủ nghề nghiệp của bác sĩ, đồng thời đảm bảo an toàn và lòng tin của bệnh nhân trong thời đại AI.

8. Tài liệu tham khảo

- Ajunwa I. The Quantified Worker: Law and Technology in the Modern Workplace. Cambridge University Press, 2023.

- Duggan MJ, Gervase J, Schoenbaum A, et al. Clinician experiences with ambient scribe technology to assist with documentation burden and efficiency. JAMA Netw Open. 2025;8(2):e2460637.

- Solomon J. How strategies for managing patient visit time affect physician job satisfaction: a qualitative analysis. J Gen Intern Med. 2008;23:775–80.

- Small WR, Wiesenfeld B, Brandfield-Harvey B, et al. Large language model–based responses to patients’ in-basket messages. JAMA Netw Open. 2024;7(7):e2422399.

- Vigoda MM, Lubarsky DA. Failure to recognize loss of incoming data in an anesthesia record-keeping system may have increased medical liability. Anesth Analg. 2006;102:1798–802.